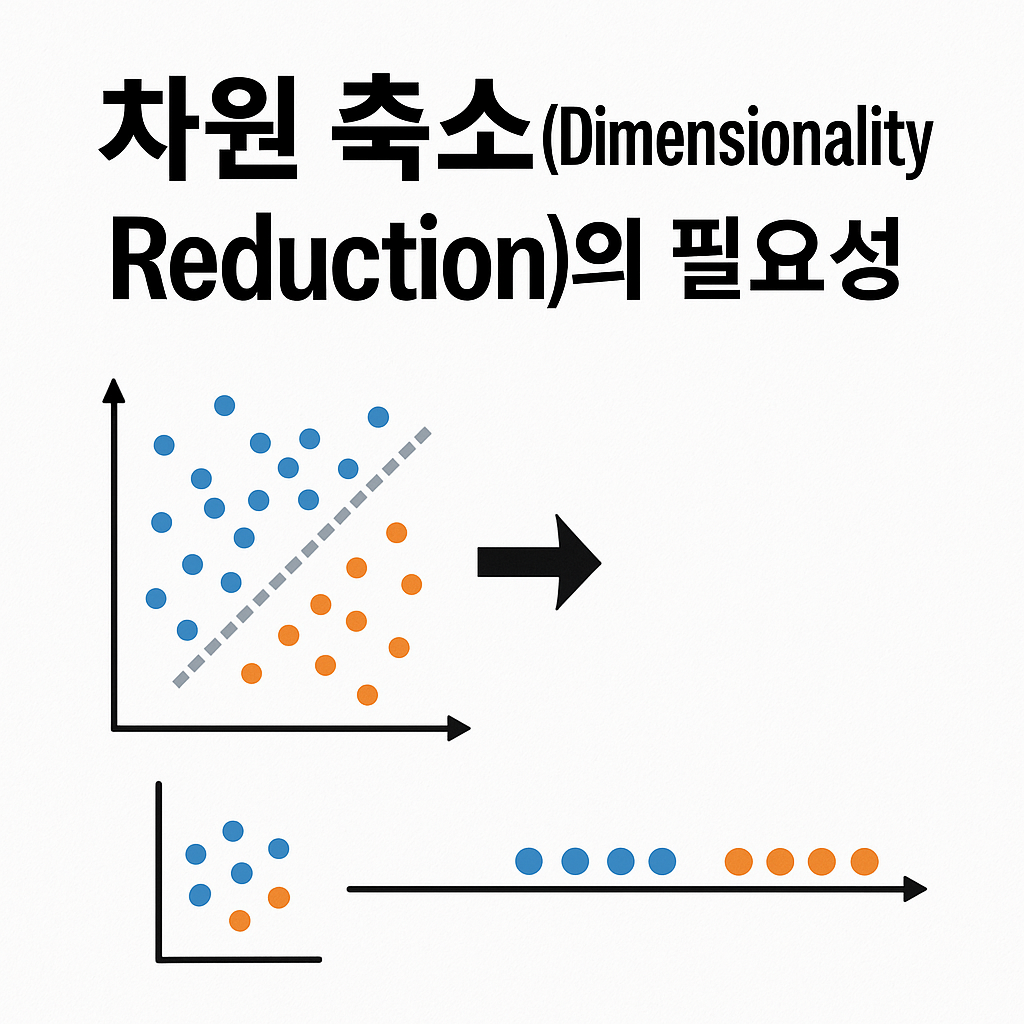

차원 축소(Dimensionality Reduction)의 필요성 🚀

"차원이 많아질수록 문제가 생긴다?"

데이터가 많다고 좋은 건 아닙니다.

이럴 때 필요한 게 바로 차원 축소예요.

안녕하세요, 여러분!

오늘은 비지도학습의 핵심 중 하나인 차원 축소(Dimensionality Reduction)에 대해 이야기해볼게요.

아마도 데이터가 많아질수록 분석이 더 잘될 거라 생각하신 적 있으시죠? 저도 그랬습니다.

그런데 웬걸, 변수(피처)가 많아지면 오히려 모델 성능이 나빠지고 시각화도 어렵고... 정신이 하나도 없더라고요. 😵

그래서 그때 등장한 개념이 바로 이 차원 축소입니다.

단순히 숫자를 줄이는 게 아니라, 진짜 중요한 정보만 쏙쏙 뽑아서 효율적으로 분석하는 기술이죠.

이번 글에서는 왜 차원 축소가 필요한지, 언제 사용하면 좋은지, 그리고 Orange Data Mining에서 어떻게 활용할 수 있는지도 예제로 보여드릴게요!

목차

1. 차원의 저주란 무엇인가요? 🌀

"차원의 저주(Curse of Dimensionality)"는 머신러닝이나 데이터 분석에서 자주 나오는 핵심 개념이에요. 말 그대로, 차원이 많아지면 분석이 더 어려워진다는 뜻이죠.

여기서 말하는 '차원'이란 변수의 개수, 즉 특성(feature)의 수를 말해요.

예를 들어, 2차원 공간에서는 데이터를 시각화하기 쉬워요.

산점도를 그려서 눈으로 확인할 수 있으니까요.

그런데 차원이 100개면 어떨까요? 상상만 해도 끔찍하죠. 시각화는커녕 거리 계산도 애매해지고, 모델이 학습하기도 어려워집니다.

📉 차원의 저주로 인한 문제점

- 거리 개념이 희석됨:

고차원에서는 모든 데이터 간 거리가 비슷해져서, KNN 같은 거리 기반 알고리즘이 무용지물이 될 수 있어요. - 과적합(overfitting) 위험 증가:

불필요한 특성이 많으면 모델이 노이즈까지 학습하게 됩니다. - 시각화 불가능:

사람이 이해하기 쉬운 2~3차원을 넘어서면 패턴 파악이 어려워져요. - 학습 속도 저하:

불필요한 차원이 많으면 학습 시간도 길어지고 계산량도 증가합니다.

📌 정리하자면...

차원이 늘어나면 정보도 늘어날 것 같지만, 실제로는 모델 성능은 더 나빠지고, 분석은 어려워지는 함정이 있어요. 그래서 "진짜 중요한 정보만 남기고 나머지를 줄이는 기술", 즉 차원 축소가 필요해지는 거죠.

📊 예시로 이해해보기

예를 들어,

어떤 쇼핑몰의 고객 데이터를 분석할 때 고객의 나이, 성별, 구매 금액, 페이지 체류 시간 등 다양한 정보가 있을 수 있어요.

이걸 모두 다루면 모델이 복잡해지지만, 실제로 중요한 변수는 '최근 구매 여부'나 '상품 클릭 수' 정도일 수 있죠.

이처럼 불필요한 특성을 제거하고 핵심만 남기는 작업이 바로 차원 축소예요.

자, 여기까지 읽으셨다면 이제 "차원이 많으면 무조건 좋은 건 아니다!"라는 감이 오셨을 거예요. 😎

2. 차원 축소가 필요한 이유 ✂️

차원 축소는 말 그대로 데이터의 차원 수를 줄이는 작업이에요.

하지만 단순히 줄이는 게 아니라, 중요한 정보는 최대한 유지하면서 덜 중요한 정보들을 제거하는 거예요.

왜 그런 작업이 필요한 걸까요? 한 번 차례대로 살펴볼게요!

🧠 1. 모델 성능 향상

변수가 많으면 많을수록 좋다고 생각할 수 있지만, 현실은 반대일 수 있어요.

불필요한 변수는 모델이 ‘잡음’을 학습하도록 만들기 때문이죠.

결과적으로 정확도가 떨어지고 예측력도 낮아집니다.

⏱️ 2. 계산 속도 개선

고차원 데이터는 컴퓨터가 계산하는 데 더 많은 시간과 자원이 필요해요.

특히 대용량 데이터일수록 학습 시간이 길어지기 때문에, 불필요한 차원을 줄이면 연산 속도도 개선돼요.

🧩 3. 시각화 가능

사람은 2차원, 3차원까지만 시각적으로 이해할 수 있어요.

데이터를 2D 또는 3D로 줄여야 패턴을 눈으로 확인할 수 있죠.

예를 들어, PCA나 t-SNE를 이용하면 복잡한 데이터를 저차원으로 줄여서 시각화할 수 있어요.

🚫 4. 다중공선성 제거

여러 특성 간에 높은 상관관계가 있으면 모델은 어떤 특성에 가중치를 줘야 할지 혼란스러워져요.

이를 다중공선성(multicollinearity)이라고 하는데, 차원 축소 기법은 이를 해결해 줍니다.

예를 들어, PCA는 상관성이 높은 특성을 통합해서 대표 축으로 변환해요.

📚 5. 저장 공간과 비용 절감

데이터가 커지면 저장 용량도 커지겠죠?

그런데 많은 변수가 필요 없다면, 그만큼 저장 공간을 절약할 수 있고, 클라우드 저장 비용이나 전송 비용도 줄일 수 있어요.

특히 사물인터넷(IoT) 같은 환경에서는 굉장히 중요한 요소입니다.

📌 정리 리스트

- 모델 성능 향상 (정확도, 예측력 개선)

- 연산 속도 개선

- 데이터 시각화 가능

- 다중공선성 제거

- 저장 비용 절감

그러니 데이터 분석이나 머신러닝을 할 때, 차원 축소는 선택이 아니라 필수예요!

다음 파트에서는 대표적인 차원 축소 기법들을 함께 살펴볼게요 :)

3. 대표적인 차원 축소 방법 소개 🧰

차원 축소 기법은 정말 많지만, 오늘은 기초 + 실전에서 자주 쓰이는 3가지 방법만 집중해서 소개할게요.

각 방법마다 특징이 다르기 때문에, 상황에 따라 적절하게 선택해야 해요.

📌 1. 주성분 분석 (PCA, Principal Component Analysis)

- 가장 널리 쓰이는 차원 축소 기법으로, 서로 상관관계가 높은 특성들을 하나의 새로운 축으로 묶어주는 방식이에요.

- 축은 '분산이 가장 큰 방향'으로 만들어지며, 이 방향이 가장 많은 정보를 담고 있어요.

- 데이터 시각화, 노이즈 제거, 전처리 등 다양하게 활용됩니다.

🎯 2. t-SNE (t-distributed Stochastic Neighbor Embedding)

- 고차원 데이터의 구조를 2D 또는 3D로 시각화하는 데 특화된 기법이에요.

- 비선형 방식이라서 PCA보다 더 복잡한 패턴을 잘 표현할 수 있어요. 하지만 해석은 조금 어려울 수 있죠.

- 처리 속도가 느리지만, 시각적 품질은 최고입니다. 💎

🪄 3. LDA (Linear Discriminant Analysis)

- PCA가 데이터의 분산만 고려하는 반면, LDA는 클래스 간 분리를 목표로 해요.

- 주로 분류 문제에서 성능 향상을 위해 사용되며, 데이터가 라벨을 가지고 있어야 해요.

🔍 비교 요약 테이블

| 기법 | 방식 | 주요 목적 | 특징 |

|---|---|---|---|

| PCA | 선형 | 정보 손실 최소화 | 속도 빠르고 해석 쉬움 |

| t-SNE | 비선형 | 시각화 | 시각적 품질 뛰어남 |

| LDA | 선형 | 클래스 분리 | 레이블 필요, 분류 특화 |

이제 대표적인 차원 축소 기법들이 어떤 역할을 하는지 이해되셨죠?

다음 장에서는 Orange Data Mining 툴로 직접 차원 축소를 해볼 거예요! 🍊

4. Orange에서 차원 축소 실습해보기 🍊

지금까지 개념만 들으면 머릿속에 뭔가 복잡한 수식만 떠오를 수 있어요. 🧠

하지만 걱정 마세요!

Orange Data Mining을 사용하면 직관적인 시각화와 노코드 환경에서 손쉽게 차원 축소를 실습할 수 있어요.

그럼 함께 실습해볼까요?

🔧 예제: Iris 데이터로 PCA 해보기

- 1. File 위젯으로 Iris 데이터셋을 불러옵니다.

- 2. PCA 위젯을 연결해서 차원 축소를 적용합니다.

- 3. Scatter Plot 위젯을 연결해서 시각화합니다.

위 과정을 따라하면, 기존 4차원 데이터가 2차원으로 줄어들고, 꽃의 종류(setosa, versicolor, virginica)가 어떻게 구분되는지 시각적으로 명확하게 확인할 수 있어요.

🧪 실습 구성 예시 (워크플로우 구성)

- File → Data Table → PCA → Scatter Plot

- PCA → Test & Score → Classification Model (e.g. Logistic Regression)

🎨 결과 해석 팁

PCA로 축소한 두 축(PC1, PC2)은 원래 특성의 조합이에요.

이 두 축으로 그려진 산점도를 보면 각 클래스가 얼마나 잘 분리되는지 확인할 수 있어요.

분리가 명확하다면, 차원 축소가 잘 된 거예요! 👏

🎉 실전 팁: Feature Scoring과 함께 사용하기

PCA 전에 Feature Scoring 위젯을 사용해서, 어떤 특성이 중요한지도 먼저 확인해보세요.

중요한 특성만 골라 PCA를 적용하면 더 좋은 결과가 나올 수 있어요!

🔍 요약하면?

- Orange에서는 PCA, t-SNE, MDS 등 다양한 차원 축소 기법을 손쉽게 사용할 수 있어요.

- 직관적인 시각화와 드래그 앤 드롭 인터페이스로 초보자도 쉽게 실습 가능!

자, 이제 이론뿐 아니라 실습까지 경험하셨으니, 진짜 차원 축소의 의미가 몸으로 와닿지 않나요? 😄

다음 파트에서는 실생활에서 이 기술이 어떻게 쓰이는지도 알아볼게요.

5. 실제 데이터에 적용되는 사례들 🧪

"차원 축소가 좋긴 하다는데, 실제로는 어디에 쓰이나요?"라는 질문, 정말 많이 받았어요.

이번엔 이 기술이 실전에서 어떻게 활용되고 있는지 구체적으로 알아보겠습니다.

🛍️ 1. 고객 행동 분석과 마케팅

대형 쇼핑몰에서는 수천만 건의 고객 행동 데이터를 분석하죠.

상품 클릭 수, 체류 시간, 검색 키워드, 장바구니 이동 등 수백 개 변수가 쏟아집니다.

여기서 차원 축소를 사용하면 중요한 행동 패턴만 추출해서 고객을 세그먼트(그룹)로 나눌 수 있어요.

🧬 2. 유전체(Genome) 분석

유전자 데이터는 수천, 수만 개의 변수로 이뤄져 있어요.

예를 들어, 암 환자와 건강한 사람의 유전자를 비교할 때, 차원 축소를 이용하면 암 발병과 관련된 유전자 패턴을 시각적으로 분리할 수 있어요. 연구에선 PCA, t-SNE가 자주 쓰여요.

🎨 3. 이미지 인식 및 압축

이미지는 수천 픽셀로 구성되죠. 하지만 사실 중요한 정보는 아주 일부에 있어요.

이미지를 벡터로 바꾸고 차원 축소를 통해 주요 특징만 뽑아내면, 인식 정확도는 그대로 유지하면서 속도는 훨씬 빨라집니다. 얼굴 인식 기술에서도 활용돼요.

💬 4. 텍스트 데이터 분석 (NLP)

문장을 숫자로 표현하면 수천~수만 차원이 돼요.

이걸 TF-IDF, Word2Vec 같은 벡터화 기법으로 처리한 후 PCA나 t-SNE를 적용하면, 텍스트 간 유사도나 분포를 시각화할 수 있답니다.

예를 들어, 뉴스 기사를 분류하거나 클러스터링할 때 유용하죠.

🧠 5. 머신러닝 모델 성능 향상

차원 축소는 단독으로도 훌륭하지만, 다른 머신러닝 알고리즘과 함께 사용할 때 더 빛을 발해요.

예를 들어, SVM, KNN 같은 모델에 적용하면 과적합을 줄이고 예측력을 높일 수 있습니다.

📝 요약 정리 리스트

- 고객 세분화, 맞춤 마케팅

- 생물학·의료 데이터 분석

- 이미지 인식 및 압축

- 텍스트 마이닝, 문서 군집화

- 머신러닝 성능 최적화

정말 다양한 분야에서 차원 축소는 핵심적인 기술로 사용되고 있어요.

마지막으로 이 모든 내용을 정리하고, 다음 단계로 연결해볼게요. 😊

6. 정리 🔗

지금까지 우리는 차원 축소(Dimensionality Reduction)가 왜 필요한지, 어떤 방식으로 구현되고, 실전에서 어떻게 활용되는지까지 살펴봤습니다. 고차원 데이터를 다룰수록 ‘데이터의 진짜 본질’을 파악하기가 어려워지는데요, 이럴 때 차원 축소는 필수 전략이 되어줍니다.

특히 Orange Data Mining과 같은 시각적 도구를 활용하면, 프로그래밍 없이도 손쉽게 차원 축소를 경험할 수 있죠. 복잡한 수식 대신 눈으로 확인하며 데이터 구조를 이해할 수 있다는 건, 정말 큰 장점이에요. 😊

혹시 지금 여러분의 데이터가 너무 복잡하게 느껴진다면? 모델 성능이 잘 안 나올 때마다 머리가 아프다면? 그럴 때 꼭 한 번, 차원 축소를 떠올려보세요. 핵심만 남기고, 불필요한 것들은 과감히 줄이는 것. 그게 진짜 데이터 분석의 출발점이 될 수 있거든요.

🧭 오늘 배운 핵심 요약

- 차원의 저주는 고차원 데이터에서 발생하는 분석의 어려움이다.

- 차원 축소는 정보 손실을 최소화하면서 변수 수를 줄이는 과정이다.

- PCA, t-SNE, LDA는 대표적인 차원 축소 방법이다.

- Orange Data Mining을 활용하면 차원 축소 실습이 시각적으로 쉬워진다.

다음 포스트에서는 실제 PCA, t-SNE 기법을 좀 더 깊게 파고들며, 차원 축소 기법 간의 비교와 선택 기준도 함께 정리해볼게요. 실습 위주로 따라오시면 여러분도 어느새 데이터 탐색 전문가가 되어 있을 거예요!

그럼 오늘도 읽어주셔서 감사합니다. 질문이나 피드백은 언제든지 환영이에요. 😊

우리 다음 글에서 또 만나요! 👋

'OrangeDataMining' 카테고리의 다른 글

| t-SNE 개념과 데이터 시각화 (1) | 2025.04.27 |

|---|---|

| 주성분 분석(PCA) 개념과 적용 (0) | 2025.04.26 |

| 실루엣 점수를 이용한 군집 평가 (0) | 2025.04.25 |

| 계층적 군집(Hierarchical Clustering) 및 덴드로그램 완전 정복 (0) | 2025.04.25 |

| K-평균(K-Means) 알고리즘 원리 완전 정복 (1) | 2025.04.24 |